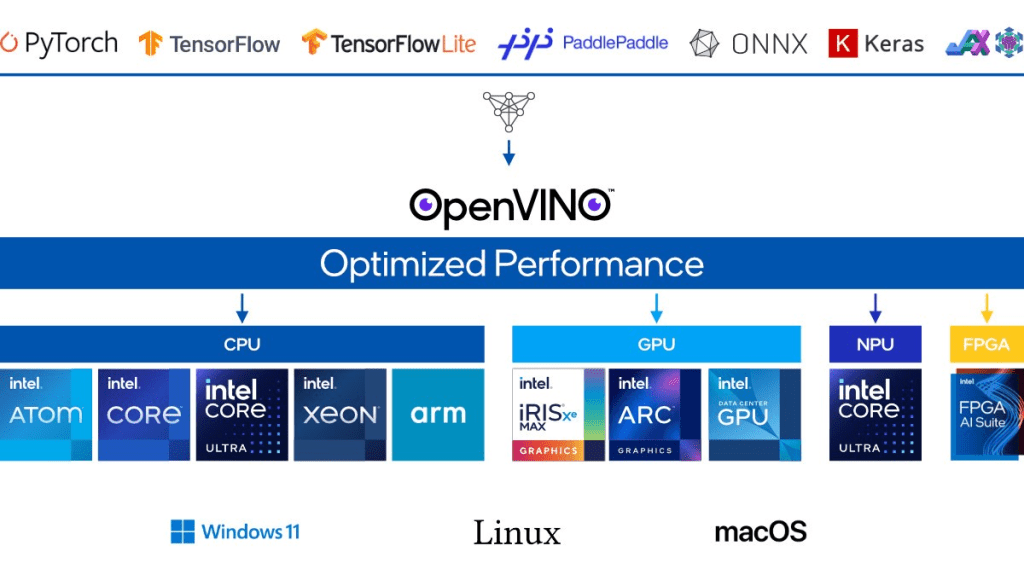

A evolução da inferência de IA em hardware Intel continua em ritmo acelerado, e o lançamento do OpenVINO 2026.1 consolida mais um avanço importante nessa jornada. Se a versão 2026.0 já havia estabelecido um novo patamar com suporte a Mixture of Experts (MoE), pipelines de Text-to-Video e técnicas mais inteligentes de compressão, a nova versão vai além: amplia significativamente o suporte a modelos, melhora a eficiência operacional e reforça o posicionamento do OpenVINO como uma das principais plataformas para inferência de IA em ambientes reais.

Mais do que uma atualização incremental, o OpenVINO 2026.1 representa uma resposta direta às demandas atuais do mercado: modelos maiores, workloads multimodais e a necessidade constante de reduzir latência sem comprometer qualidade.

Expansão de Modelos: Escalando a IA com Flexibilidade

Um dos pontos mais relevantes desta versão é a ampliação do suporte a modelos de grande porte e multimodais. O destaque vai para o suporte em CPU ao GPT-OSS 120B, um salto expressivo em relação à versão anterior (20B). Isso muda o jogo para organizações que precisam rodar modelos massivos sem depender exclusivamente de GPUs de alto custo.

Além disso, o suporte ao Qwen3 VL em CPU e GPU abre novas possibilidades para aplicações avançadas de visão computacional combinada com linguagem natural. Estamos falando de casos de uso como:

- Análise inteligente de imagens e vídeos

- Geração automática de descrições visuais

- Processamento documental com entendimento semântico

- Raciocínio multimodal em tempo real

Outro avanço importante está no OpenVINO Model Server, que agora suporta melhor modelos como Qwen3-MoE e GPT-OSS-20B. Com isso, há ganhos diretos em:

- Throughput via continuous batching

- Melhor uso de recursos em ambientes concorrentes

- Maior estabilidade em cenários de produção

E não para por aí: a introdução de endpoints de imagem com suporte a inpainting e outpainting leva o Model Server para além da inferência textual, entrando definitivamente no território da IA generativa visual.

LoRA Dinâmico e IA Multimodal: Eficiência em Escala

A adoção de LoRA dinâmico para modelos de visão e linguagem é um divisor de águas. Com suporte ao Qwen3-VL, o OpenVINO permite trocar adaptadores em tempo de execução sem recarregar o modelo base.

Na prática, isso resolve um problema crítico em produção: como servir múltiplas variações de um modelo sem multiplicar o consumo de memória e tempo de inicialização. O resultado é:

- Menor latência operacional

- Redução de custo de infraestrutura

- Maior flexibilidade para personalização de modelos

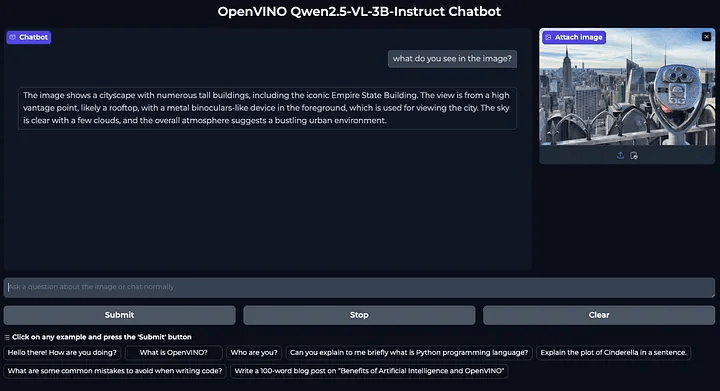

Outro ponto extremamente relevante é o novo notebook de referência que integra múltiplos VLMs, incluindo:

- Qwen2.5-VL

- LLaVA-Next-Video

Esse ambiente unificado permite explorar chatbots multimodais com suporte a vídeo e alternância dinâmica de modelos algo essencial para experimentação e benchmarking em cenários reais.

Performance: Onde o OpenVINO Realmente Brilha

Se há um ponto onde o OpenVINO tradicionalmente se destaca, é na otimização de performance e a versão 2026.1 reforça isso com avanços consistentes.

1. TaylorSeer Lite Caching

A introdução do caching TaylorSeer Lite para pipelines de difusão (como Flux, SD3 e LTX-Video) reduz computações redundantes durante o processo de denoising. Isso resulta em:

- Geração mais rápida de imagens e vídeos

- Menor consumo computacional

- Manutenção da qualidade do output

2. Otimizações em Vídeo (LTX-Video)

A fusão de operadores como RMSNorm e RoPE em um único kernel elimina overhead de execução sequencial. Esse tipo de otimização de baixo nível traz ganhos significativos:

- Redução de latência de kernel

- Menor uso de memória

- Aumento expressivo no throughput

3. Prompt Lookup Decoding

A extensão dessa técnica para pipelines multimodais é um dos avanços mais interessantes. Ao reutilizar padrões de tokens já processados, o sistema reduz a carga no modelo principal, acelerando a geração de tokens.

Isso é particularmente relevante para:

- Chatbots multimodais

- Assistentes com contexto longo

- Sistemas de análise documental

Um Novo Patamar para Inferência em Hardware Intel

O OpenVINO 2026.1 deixa claro que a estratégia da Intel não é apenas competir é redefinir o espaço de inferência eficiente. Ao permitir que modelos massivos rodem em CPU, otimizar pipelines multimodais e introduzir mecanismos inteligentes de caching e decoding, a plataforma se posiciona como uma solução altamente pragmática para empresas.

Em um cenário onde custo, performance e escalabilidade precisam coexistir, o OpenVINO oferece uma proposta extremamente equilibrada.

Para quem trabalha com IA aplicada seja em edge, cloud ou ambientes híbridos essa versão não é apenas uma atualização. É um convite para repensar arquitetura, otimizar pipelines e explorar novas possibilidades com modelos cada vez mais complexos.

Conclusão

O OpenVINO 2026.1 representa um avanço sólido na democratização da IA de alto desempenho. Com mais modelos, melhor suporte multimodal e otimizações profundas de performance, a plataforma continua evoluindo para atender às demandas reais do mercado.

Se você está construindo soluções com LLMs, VLMs ou pipelines generativos, este é o momento ideal para explorar o que há de novo e, principalmente, para extrair o máximo desempenho do hardware Intel com inteligência.

A próxima geração da IA não será apenas mais poderosa , será mais eficiente. E o OpenVINO está claramente liderando esse movimento.