A detecção de objetos é uma antiga do setor de visão computacional tem o objetivo de reconhecer e localizar todos os objetos de interesse em uma imagem. A complexidade é enorme em diversos aspectos.

Conforme descrito no paper, é possivel incorporar o conhecimento prévio específico da tarefa com uma técnica de aumento de sequência. Assim surgiu o projeto “Pix2Seq: A Language Modeling Framework for Object Detection”, publicado na ICLR 2022, foi proposto / apresentamos um método simples e genérico que trata a detecção de objetos de uma perspectiva completamente diferente comparado a tudo que conhecemos até o presente momento. Ao contrário dos projetos existentes que são específicas da tarefa, foi proposto a detecção de objetos como uma tarefa de modelagem de linguagem condicionada às entradas de pixel observadas.

Os resultados demonstrados pelo projeto Pix2Seq são animadores e competitivos ao projetos/algoritmos de detecção altamente especializados e bem otimizados existentes. O desempenho do Pix2Seq pode ser melhorado ainda mais com o pré-treinamento de dataset de objetos maior. O projeto foi disponibilizado para comunidade de desenvolvedor/pesquisadores no link : https://github.com/google-research/pix2seq

Conceito do Pix2Seq

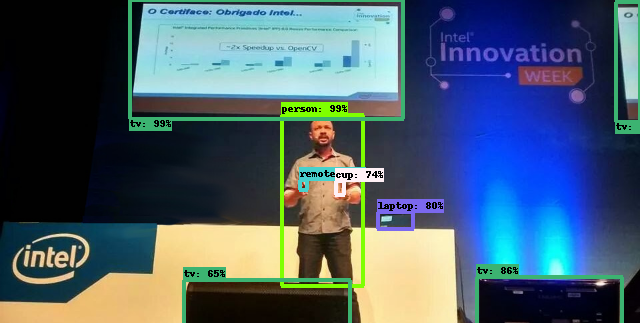

A tecnologia é baseada na intuição se uma rede neural sabe onde e quais são os objetos em uma imagem. ( Veja na imagem de teste acima, a dedução de um controle remoto e um copo em minhas mãos ). Durante o aprendizado, o modelo pode aprender a fundamentar as descrições em observações de pixels, levando a representações úteis de objetos. Ao submeter uma imagem, o modelo Pix2Seq gera uma sequência de descrições de objetos, onde cada objeto é retornado usando cinco parâmetros: as coordenadas da região de interesse [ymin, xmin, ymax, xmax] e um rótulo de classe de objetos.

O Pix2Seq propõe uma quantização e serialização que converte as regiões de interesse e nome da classe em sequências de tokens discretos (semelhantes a legendas) e dispara uma arquitetura de codificador-decodificador para entender as entradas de pixel e gerar a sequência de descrições de objetos.

Em breve mais novidades.